This post is also available in .

Je hebt weleens gehoord van ‘auditieve’ en ‘visuele’ hersengebieden. Hoe integreert je brein deze zintuigen als je iemand ziet spreken? Ons onderzoek suggereert dat het brein niet categoriseert.

Afbeelding via Pixabay (CC0), bewerkt door Cristiano Micheli.

Heb je je ooit afgevraagd waarom het zo veel makkelijker is om jezelf te verliezen in het kijken van YouTube video’s dan in het lezen van een boek? In een recent gepubliceerd onderzoek hebben we geprobeerd te begrijpen hoe dit komt door met elektroden te kijken hoe het brein twee modaliteiten integreert: audio en video.

Het experiment

In het onderzoek keken we naar welke breingebieden geactiveerd werden wanneer mensen anderen zagen praten. Wetenschappelijke experimenten gebruiken vaak kunstmatige audio stimuli, wat vaak niet erg lijkt op de dagelijkse interacties. We weten dat in dagelijkse interacties we niet alleen onze oren maar ook onze ogen gebruiken. Denk bijvoorbeeld aan wanneer je op een feestje of een lawaaiige straat bent, en je probeert te begrijpen wat je vriend zegt: de mond en andere visuele signalen helpen de gaten te vullen in het lawaaiige geluidssignaal. Dus, hoe brengt het brein deze twee signalen (auditief en visueel) samen in één zodat we het als een geheel waarnemen; namelijk een pratend persoon? We probeerden deze vraag te beantwoorden door directe activiteit te meten bij proefpersonen die een filmpje keken van een sprekend persoon. (Maak je niet druk, we hebben de hersenen van de proefpersonen niet zelf blootgelegd. Ze lagen al in het ziekenhuis en de elektrodes waren geïmplanteerd om andere aandoeningen te monitoren.)

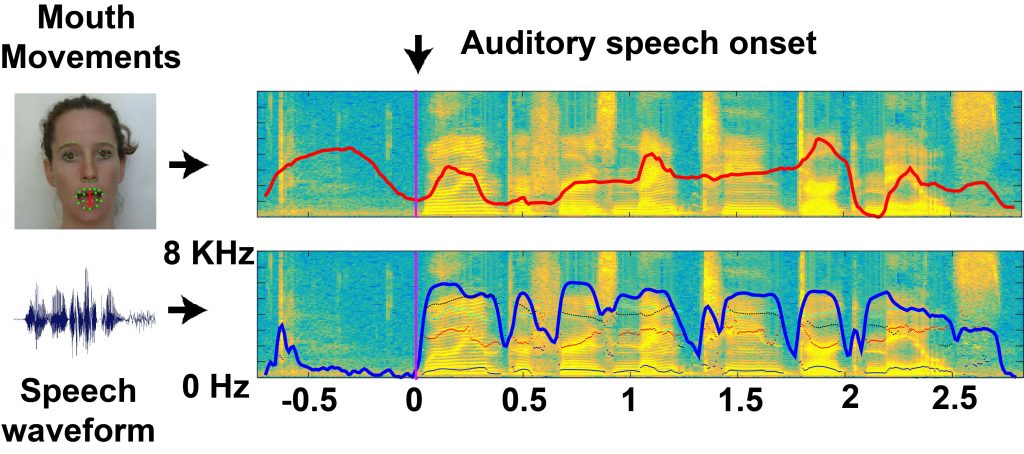

Mondbewegingen (rood) en spraakgolven (blauw) zijn gecorreleerd aan hersenactiviteit om vast te stellen op welke plekken de multisensorische integratie plaatsvindt.

Afbeelding door Cristiano Micheli.

Volgens ons onderzoek lijkt het alsof er in het brein een knooppunt is waar informatie over beeld en geluid samenkomt. Dit is het achterste (posterior) gedeelte van de temporaalkwab, precies op de splitsing van visuele en auditieve hersengebieden. Echter, dingen waren niet precies zoals we ze verwachtten: we vonden dat auditieve signalen ook in visuele gebieden verwerkt werden, en dat visuele signalen ook in temporale gebieden verwerkt werden (een hersengebied waar normaal voornamelijk geluid wordt verwerkt)!

Multifunctionele breingebieden

Eerder werd gedacht dat de input van elk zintuig in een ander hersengebied wordt verwerkt, maar ons onderzoek trekt dit in twijfel en ondersteunt de theorie van multi-sensorische verwerking. Dit lijkt ook veel logischer, toch? Waarom zou het brein in afdelingen zijn ingedeeld? Het is simpelweg veel efficiënter voor onze ‘hardware’ om auditieve en visuele informatie door te sturen en te dupliceren in meerdere breingebieden, zelfs als dit onnodig is. Het is een beetje zoals het maken van meerdere kopieën van hetzelfde bestand om vervolgens met elke kopie iets anders te doen.

Dus de volgende keer als je je schuldig voelt dat je weer series zit te bingen, stel jezelf dan gerust met het feit dat het brein geëvolueerd is om lawaaiige objecten te detecteren, en niet om boeken te lezen. Dat gezegd hebbende, het zal je ook geen kwaad doen om eens wat te lezen. Je kunt mooi beginnen met het lezen van ons paper!

Geschreven door Cristiano Micheli, aangepast door Mónica Wagner en vertaald door Rowena Emaus.